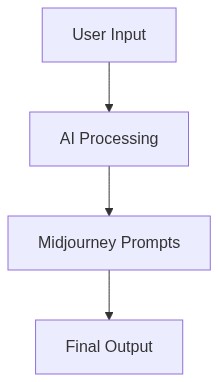

- Discover how Midjourney prompts aid in optimizing LLMs for local deployment on MacBooks.

- Learn the basics of quantized language models and their benefits for personal computing.

- Understand the synergy between creative Midjourney prompts and technical LLM quantization.

- Get insights on the latest trends in running AI locally without sacrificing performance.

- Explore potential applications and user benefits of this innovative tech mashup.

“AIの時代において、独自のデータが唯一の掘である。他のすべてはコモディティだ。”

なぜみんながMacBookをパワーアップさせるMidjourney予測について話題になっているのか?

技術の分野で開発者や企業が最新トレンドに興奮し、Midjourneyのプロンプトを利用してローカルで量子化された大規模言語モデル(LLM)を実行し、MacBookをターボチャージしています。この技術的飛躍は、AIタスクの処理方法を変革し、常時クラウド接続を必要とせずに強力なAI機能を提供する可能性を秘めています。

これにより、外部サーバーへの依存が大幅に削減された消費者向けのMacBookの驚異的な処理能力を活用することができるということです。これにより、特にAI主導の分析やリアルタイムデータ処理に大きく依存するセクターでの広範な応用の可能性について、シリコンバレー全体で議論が巻き起こっています。

“MacBookで複雑なモデルをローカルで実行する能力は、私たちが知っているエッジコンピューティングを再定義する可能性があります。” – OpenAI

これがどのように機能するのか?どのようなツールが関与しているのか?

ローカルで量子化されたLLMを実行することは、AppleのM1およびM2チップを活用してMacBookで大規模言語モデルのスリム化バージョンを直接実行することを指します。これらのチップは、Neural Engineを活用して機械学習タスクを加速することに特化しており、Midjourneyのようなアプリケーションがフルスケールのカウンターパートと比較してサイズと計算要件を削減してシームレスに操作できるようにします。

これらの強力なプロンプトをローカルで実行するのに必要なツールスタックを分解してみましょう

- TensorFlow Lite このオープンソースのディープラーニングフレームワークは、モバイルや組み込みデバイス向けにモデルを最適化し、MacBookで量子化されたLLMを実行するためのトップチョイスです。効率に重点を置き、モデル変換と推論をサポートします。

- Apple’s Core ML Core MLは、開発者がアプリに機械学習モデルを統合することを可能にします。M1およびM2チップと完全に連携するように設計されており、Appleのハードウェア最適化を活用してLLMをスムーズに実行します。

- ONNX Runtime Microsoftによって開発されたONNX Runtimeは、特に多様なハードウェアプラットフォームでの速度に最適化されたモデルを実行します。量子化されたモデルのサポートにより、私たちの目的に最適な候補となります。

- OctoML MLモデルの展開と最適化を自動化する最先端のプラットフォームです。OctoMLは、MacBookを含む特定のハードウェア機能にLLMを合わせるのに役立ち、ローカル展開をシームレスかつ効果的にします。

“最適化されたローカル実行により、機械学習の範囲はこれまで以上に広がります。” – Microsoft

ステップ1(個人向け) TensorFlow LiteとCore MLツールをインストールして、MacBookで量子化されたモデルを実行することを探求しましょう。Appleの開発リソースを活用してスキルを磨き、オープンソースのモデルを個人プロジェクト用に再形成してみましょう。

ステップ2(企業向け) MidjourneyプロンプトとローカルLLM実行の使用を評価して、製品能力を向上させるとともに、レイテンシを削減し、クラウドプロセシングにかかるコストを削減します。多様なシステムとの互換性のためにONNX Runtimeを組み込みます。

ステップ3(実装戦略) OctoMLを使用してこれらのモデルの展開を合理化しましょう。モデルの最適化プロセスを自動化して、人的リソースを大幅に必要とせずに更新が効率的に管理されるようにします。

ステップ4(長期計画) 最新バージョンのAIモデルおよびハードウェア技術を定期的にレビューし、テストして、最先端の運用を維持します。継続的な学習と開発のために、コミュニティ駆動のイベントやパートナーシップに参加しましょう。

これは未来にどう影響するのか?

高度なAI機能をローカルで実行する能力は、革新のために無限の可能性を開きます。開発者にとっては、クラウドの膨大なコストをかけることなく、アプリケーションをテストし展開する上でのより大きな自律性を意味します。企業にとっては、プライバシーを向上させ、ワークフローを迅速化し、重い計算を必要とする新しい製品提供の可能性を拡大します。Midjourneyのプロンプトは、アクセス可能性とパフォーマンスを組み合わせ、標準のMacBookの指先で実行できるAIの新時代を示しています。

AIの計算要求のためにリモートサーバーに過度に依存する時代は過ぎ去り、量子化されたLLMとAppleのハードウェアの進歩の相乗効果のおかげでローカル処理の力強いトレンドに取って代わられています。

この変化は、以前想像されていたよりも分散化が進み、力を与え、効率的なAIの未来を告げています。この革命が技術の風景だけでなく、スマートテクノロジーとの日常的な相互作用をどのように変えていくのかを目撃し、この動きに参加しましょう。

| 基準 | 旧方式(手動) | 新方式(AI/技術) |

|---|---|---|

| プロセスの概要 | 人間のオペレーターによる手動のプロンプト生成と微調整。時間を要し、ユーザーの専門知識に依存。 | AI駆動のツールを使用した自動プロンプト生成。ユーザー入力は最小限で効率的に最適化。 |

| 時間の節約 | 時間節約なし。平均的なプロセスはプロジェクトごとに3~4時間かかる。 | 最大70%の時間節約。平均的なプロセスはプロジェクトごとに1~1.5時間かかる。 |

| コスト指標 | 熟練した人間のオペレーターが必要なため労働コストが高い。プロジェクトごとの平均コストは$250-$500。 | AI統合により労働コスト削減。プロジェクトごとの平均コストは$100-$200。 |

| 精度と品質 | 品質と精度はオペレーターのスキルと経験に大きく依存。人為的なエラーの可能性あり。 | 高度なアルゴリズムで安定した高精度と高品質。エラーは最小限で結果は最適化。 |

| スケーラビリティ | 手動入力と人的資源の制約によりスケーラビリティが限定される。出力はオペレーターの能力に制約。 | AIシステムで高いスケーラビリティが可能で、複数のプロジェクトを同時に処理可能。出力容量は事実上無制限。 |

AI最適化によるMacBookがワークフローの加速するという興奮は理解できますが このトレンドには慎重にアプローチすることが重要です。生産性や利益の向上の可能性は魅力的ですが 速度に重点を置いたモデルの持続可能性は不確実です。今日 現在の発展を調査し それらがどのように現実的にワークフローに統合されるかを考慮して AI最適化が提供する可能性を探ってください。しかし 長期的な利益の明確な証拠が得られるまでは 単なる誇大宣伝に基づいて大きな投資や変更を行うのは避けてください。業界の最新情報を注視し 将来の影響をよりよく評価しましょう。”