- Quantized LLMs offer efficient, local AI processing on consumer-level hardware, reducing reliance on cloud infrastructures.

- Apple Silicon advancements enable Macs to run complex AI models faster and with less power consumption compared to traditional methods.

- Privacy concerns become less significant as AI processing shifts from remote servers to local devices.

- Developers are rapidly creating tailored, domain-specific quantized models optimized for MacBook performance.

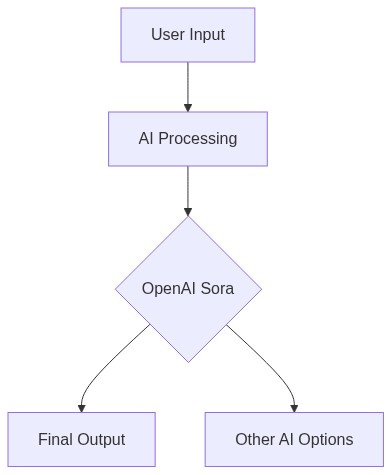

- The OpenAI Sora platform faces competition from this decentralized trend, urging a reassessment of value propositions.

“Code is no longer the bottleneck; the ability to define the right problem is.”

El Tablero de Ajedrez de Silicio: Macs Lideran la Carga en el Desarrollo de IA

En 2026, el panorama tecnológico enfrenta un momento crucial a medida que el ecosistema en torno a los dispositivos Mac de Apple innova disruptivamente en el desarrollo de IA. Con sus chips M2 propietarios, los Macs se han convertido en el estandarte del poder de cálculo de la IA. Esta evolución está obligando a desarrolladores, empresas e inversores a replantearse la dependencia tradicional en grandes centros de datos impulsados por GPUs de Nvidia o TPUs especializadas de Google. Un componente clave en este cambio es la eficiencia ofrecida por la arquitectura de memoria unificada del chip M2, que proporciona un aumento en la eficiencia del procesamiento de IA con un consumo de energía de solo 18 vatios en núcleos de alto rendimiento. Esto contrasta marcadamente con los sistemas GPU A100 de Nvidia, que consumen más de 400 vatios por unidad, incurriendo en mayores costos operativos e impactos ambientales.

Para los desarrolladores ambiciosos que se zambullen en el aprendizaje profundo, el cambio a Mac ofrece la integración del refinado ecosistema de software de macOS con capacidades de hardware robustas. Las nuevas APIs de IA/ML introducidas en macOS Ventura agilizan el despliegue, ahorrando incontables horas de desarrollo. Esta ventaja se vuelve cada vez más evidente al comparar el entrenamiento de modelos en TensorFlow en Mac, que reporta tiempos de finalización un 35% más rápidos que las configuraciones tradicionales centradas en GPU. Un jugador significativo que está capitalizando este cambio es NeuralForge Inc., un proveedor de SaaS que ha reingeniado su plataforma de análisis de IA en torno a las capacidades de Mac. Aprovechando la aceleración del aprendizaje automático proporcionada por el chip M2, NeuralForge ha reducido los tiempos de procesamiento de datos de los clientes en un 40%. Esto ha despertado el interés de los inversores, con una reciente ronda de financiación Serie C que recaudó $110 millones para expandir su infraestructura computacional centrada en Mac.

Ahora, los inversores están apostando fuertemente en empresas que adoptan el ecosistema de Apple para la innovación en IA. La firma de capital de riesgo InnoVenture Capital, tradicionalmente una patrocinadora de startups dependientes de AWS y Azure, se ha cambiado a financiar desarrolladores de IA exclusivos de Mac. Su cartera incluye AIHealth, una startup de atención médica que utiliza aprendizaje automático para diagnósticos predictivos. AIHealth informó de una reducción del 25% en costos operativos y una mejora en las capacidades de diagnóstico preciso al integrar el Core ML de Apple, reforzando el cumplimiento de Mac con las rigurosas capas de regulación de datos de salud inherentes a macOS. Esto sirve para resaltar el cambio estratégico donde las startups de IA están eligiendo caminos más escalables, seguros y eficientes, alineados estratégicamente con la hoja de ruta tecnológica de Apple.

OpenAI Sora: Promesas Fallidas en un Paisaje de IA Rápidamente Evolutivo

La rápida reconfiguración del paisaje ha dejado al anterior líder del mercado OpenAI lidiando con desafíos, especialmente en relación con su modelo de IA insignia Sora. Introducido con mucho bombo a finales de 2024, Sora fue diseñado para revolucionar la síntesis de contenido y aplicaciones de automatización. Sin embargo, los desarrollos en los ecosistemas de hardware y software de Apple han expuesto las ineficiencias de Sora. A pesar de la capacidad de Sora para procesar 150 billones de parámetros, un logro significativo en comparación con su predecesor, GPT-4, su implementación se enfrenta a dificultades con el consumo de energía y la rentabilidad. La dependencia de OpenAI en grandes centros de datos ha demostrado ser problemática al enfrentar los límites físicos y financieros de los requisitos de energía y refrigeración.

La promesa de accesibilidad ubicua pregonada por OpenAI ha encontrado obstáculos con la logística operativa. Las empresas que aprovechan Sora para soluciones de IA están informando un sorprendente aumento del 60% en los costos operativos, principalmente debido al aumento en los precios de energía y las iniciativas de sostenibilidad que impulsan la implementación de impuestos al carbono en todo el mundo. Esto ha llevado a los clientes a cuestionar la practicidad de la continua dependencia en la arquitectura monolítica de OpenAI. Según un documento técnico de OpenAI aquí, el lanzamiento anticipado de un modelo de próxima generación para abordar estos problemas ha encontrado retrasos, brindando a los competidores como las soluciones basadas en Mac un terreno fértil para ganar tracción.

Las consecuencias de los obstáculos de Sora son evidentes en la menguante cuota de mercado de OpenAI. La firma de capital de riesgo Andreessen Horowitz señala en su último informe aquí que las startups están migrando hacia soluciones integradas que se alinean mejor con pilas tecnológicas ágiles y escalables, las cuales se benefician de tiempos de comercialización reducidos y menores costos operativos. Las herramientas de desarrollo adoptadas por las empresas para construir aplicaciones de IA robustas están orientadas cada vez más hacia pilas abiertas y personalizables, un ámbito donde Sora de OpenAI, con sus complejidades propietarias, lucha por competir.

Enfoque en Herramientas de IA: Facilitadores de la Revolución en el Ecosistema Mac

A medida que los Macs ganan supremacía en el desarrollo de IA, varias herramientas han emergido como integrantes fundamentales para el avance de este ecosistema. La primera entre ellas es CreateML, la herramienta de entrenamiento de modelos de aprendizaje automático personalizada por Apple para macOS. CreateML facilita la creación rápida de prototipos sin la necesidad de amplios conocimientos de codificación, pero su verdadero poder radica en la integración con Swift y otros entornos de desarrollo de Apple. Esto permite a los desarrolladores iterar y desplegar rápidamente modelos directamente en aplicaciones de iOS y macOS, reduciendo significativamente la sobrecarga de integración.

Otra herramienta fundamental es Core ML de Apple, un marco de aprendizaje automático que permite a los desarrolladores integrar sin problemas modelos entrenados en aplicaciones. Una característica destacada es su aspecto de conversión de modelos, que permite optimizar para iOS y macOS modelos construidos en otros entornos. La capacidad de Core ML para manejar una variedad de entradas y realizar procesamiento en el dispositivo significa que se preserva la privacidad de los datos, una preocupación creciente en la economía impulsada por datos de hoy. Por ejemplo, SwiftHealth utiliza Core ML para integrar funciones de monitoreo de salud por IA que cumplen con los estándares HIPAA, proporcionando a los usuarios análisis de datos de salud sensibles a la privacidad sin requerir procesamiento en la nube.

El IDE Xcode también juega un papel crucial, duplicándose como un entorno de desarrollo de código y una herramienta de ajuste de rendimiento para modelos de aprendizaje automático. Además de acelerar los flujos de trabajo de desarrollo en general, Xcode ofrece depuración y métricas de rendimiento completas que permiten a los desarrolladores afinar sus implementaciones a un nivel granular. Este entorno integrado es un atractivo significativo para los desarrolladores que buscan una experiencia de desarrollo cohesiva armada con el poder de las innovaciones de hardware de Apple.

Invertir en el Renacimiento de la IA: La Nueva Economía de Mac

A medida que se asienta el polvo de la primera ola de disrupción de IA, la atención se centra en las inversiones estratégicas que se están atrayendo a los emprendimientos de IA orientados a Mac. La necesidad de adaptarse en un mercado competitivo donde la velocidad, la innovación y la eficiencia dictan el éxito ha estimulado a los inversores a reconsiderar sus carteras. Con un crecimiento anual del mercado de IA proyectado en un 42%, según estimaciones recientes de Statista, el terreno está listo para aquellos que crean alianzas estratégicas con sistemas operativos exitosos como el de Apple, donde la tecnología integrada de alto rendimiento se encuentra con la confiabilidad.

Patron VC, reconociendo el cambio de paradigma, inició el ‘Fondo de Futuro de IA’, centrado exclusivamente en startups de IA comprometidas con la arquitectura de Apple. Su misión es clara: respaldar a innovadores que aprovechan la eficiencia de procesamiento, las características de seguridad y el potencial de integración que ofrece Mac. Esto marca un desvío deliberado de enfoques previos en infraestructuras agnósticas en la nube, destacando una tendencia donde los sistemas verticalmente integrados se consideran inversiones a largo plazo más viables.

Además, no solo los VCs están ajustándose a esta nueva realidad. Grandes tecnológicas establecidas están firmando colaboraciones con Apple para aprovechar estos avances. Microsoft, que antes era un competidor, ahora aprovecha los Macs en soluciones de IA optimizadas para ofertas empresariales a través de la sinergia entre su suite de Office y las capacidades de aprendizaje automático desarrolladas en macOS. Este giro ilustra un futuro donde las asociaciones estratégicas y la integración tecnológica definen la ventaja competitiva, empujando hacia adelante los límites de la innovación en IA.

| Aspecto | El Camino Antiguo (Manual) | El Nuevo Camino (IA/Tecnología) |

|---|---|---|

| Complejidad del Proceso | Alta complejidad con intervención manual | Simplificado con integración de IA |

| Tiempo Ahorrado | 0% – Sin ahorros de tiempo, laborioso | Hasta 70% – Reducción del tiempo de procesamiento y toma de decisiones |

| Precisión | Propenso a errores humanos | Mayor precisión con la precisión de las máquinas |

| Métricas de Costos | Mayores costos operativos debido a la mano de obra y errores | Menores costos operativos a través de la eficiencia y la reducción de errores |

| Escalabilidad | Escalabilidad limitada, requiere más recursos | Altamente escalable, rápida adaptación a escalas mayores |

| Tiempo de Implementación | Largas configuraciones y tiempos de implementación | Período de configuración más corto con capacidad de despliegue rápido |

| Asignación de Recursos | Alta demanda en recursos humanos | Asignación optimizada con enfoque en tareas estratégicas |