- Quantized LLMs offer efficient, local AI processing on consumer-level hardware, reducing reliance on cloud infrastructures.

- Apple Silicon advancements enable Macs to run complex AI models faster and with less power consumption compared to traditional methods.

- Privacy concerns become less significant as AI processing shifts from remote servers to local devices.

- Developers are rapidly creating tailored, domain-specific quantized models optimized for MacBook performance.

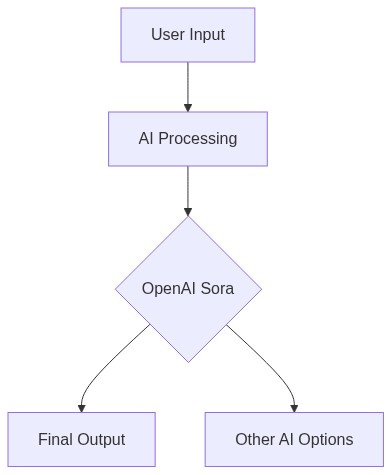

- The OpenAI Sora platform faces competition from this decentralized trend, urging a reassessment of value propositions.

“Code is no longer the bottleneck; the ability to define the right problem is.”

Das Silizium-Schachbrett: Macs führen die Entwicklung in der KI an

Im Jahr 2026 steht die Technologielandschaft an einem entscheidenden Punkt, da das Ökosystem um Apples Mac-Geräte disruptiv in der KI-Entwicklung innoviert. Mit ihren proprietären M2-Chips sind Macs zu den Standardträgern für KI-Rechenleistung geworden. Diese Entwicklung zwingt Entwickler, Unternehmen und Investoren dazu, die traditionelle Abhängigkeit von großen Rechenzentren, die von Nvidia-GPUs oder spezialisierten TPUs von Google angetrieben werden, neu zu überdenken. Ein wichtiger Bestandteil dieses Wandels ist die Effizienz, die durch die einheitliche Speicherarchitektur des M2-Chips geboten wird, wodurch die Effizienz der KI-Verarbeitung verbessert wird und der Stromverbrauch in Hochleistungskernen nur 18 Watt beträgt. Dies steht in starkem Kontrast zu den A100-GPU-Systemen von Nvidia, die mehr als 400 Watt pro Einheit verbrauchen und höhere Betriebskosten und Umweltauswirkungen verursachen.

Für ambitionierte Entwickler, die in das Deep Learning eintauchen, bietet der Wechsel zu Macs die Integration des verfeinerten Software-Ökosystems von macOS mit robusten Hardware-Funktionen. Die neuen KI/ML-APIs, die in macOS Ventura eingeführt wurden, optimieren den Einsatz und sparen unzählige Entwicklungsstunden. Dieser Vorteil wird zunehmend deutlich, wenn man das Training von TensorFlow-Modellen auf Macs vergleicht, das 35 % schnellere Abschlusszeiten als herkömmliche GPU-zentrierte Setups meldet. Ein bedeutender Akteur, der von diesem Wandel profitiert, ist NeuralForge Inc., ein SaaS-Anbieter, der seine KI-Analyseplattform rund um die Fähigkeiten von Macs neu gestaltet hat. Durch die Nutzung der maschinellen Lernbeschleunigung, die der M2-Chip bietet, hat NeuralForge die Zeit für die Verarbeitung von Kundendaten um 40 % verkürzt. Dies hat das Interesse von Investoren geweckt, da eine kürzlich durchgeführte Series-C-Finanzierungsrunde 110 Millionen US-Dollar einbrachte, um ihre Mac-zentrierte Recheninfrastruktur auszubauen.

Investoren wetten jetzt verstärkt auf Unternehmen, die das Ökosystem von Apple für KI-Innovationen annehmen. Die Risikokapitalfirma InnoVenture Capital, die traditionell Startups unterstützt hat, die auf AWS und Azure angewiesen sind, hat sich umorientiert, um ausschließlich Mac-exklusive KI-Entwickler zu finanzieren. Ihr Portfolio umfasst AIHealth, ein Gesundheits-Startup, das maschinelles Lernen für prädiktive Diagnostik nutzt. AIHealth meldete reduzierte Betriebskosten um 25 % und verbesserte präzise Diagnosefähigkeiten durch die Integration von Apples Core ML, was die Einhaltung der strengen Gesundheitsdatenschutzbestimmungen von macOS verstärkt. Dies unterstreicht den strategischen Wandel, bei dem KI-Startups zunehmend skalierbare, sichere und effiziente Wege wählen, die strategisch mit Apples technologischem Fahrplan übereinstimmen.

OpenAI Sora: Gescheiterte Versprechen in einer sich schnell entwickelnden KI-Landschaft

Die schnelle Neugestaltung der Landschaft hat den bisherigen Marktführer OpenAI mit Herausforderungen konfrontiert, insbesondere in Bezug auf ihr Flaggschiff-KI-Modell Sora. Spät im Jahr 2024 mit großem Trara eingeführt, wurde Sora entwickelt, um die Inhalts-Synthese und Automatisierungsanwendungen zu revolutionieren. Dennoch haben Entwicklungen in Apples Hardware- und Software-Ökosystemen Soras Ineffizienzen aufgezeigt. Trotz Soras Fähigkeit, 150 Billionen Parameter zu verarbeiten – ein signifikanter Erfolg im Vergleich zu seinem Vorgänger GPT-4 – kämpft sein Einsatz mit Energieverbrauch und Kostenwirksamkeit. OpenAIs Abhängigkeit von großflächigen Datenzentren hat sich als problematisch erwiesen, da sie an die physischen und finanziellen Grenzen von Strom- und Kühlanforderungen stoßen.

Das Versprechen von allgegenwärtiger Zugänglichkeit, das OpenAI propagiert hat, ist mit operativen Logistikproblemen konfrontiert. Unternehmen, die Sora für KI-Lösungen nutzen, berichten von einem atemberaubenden Anstieg der Betriebskosten um 60 %, hauptsächlich aufgrund des Anstiegs der Energiepreise und Nachhaltigkeitsinitiativen, die weltweit steuerliche Belastungen auf Kohlenstoffemissionen treiben. Dies hat dazu geführt, dass Kunden die Praktikabilität des kontinuierlichen Vertrauens in OpenAIs monolithische Architektur in Frage stellen. Laut einem Whitepaper von OpenAI hier hat sich die erwartete Veröffentlichung eines nächsten Modells zur Behebung dieser Probleme verzögert, was Mitbewerbern wie Mac-basierten Lösungen fruchtbaren Boden bietet, um an Bedeutung zu gewinnen.

Die Folgen von Soras Hürden sind in OpenAIs sinkendem Marktanteil ersichtlich. Die Risikokapitalfirma Andreessen Horowitz stellt in ihrem jüngsten Bericht hier fest, dass Startups zu integrierten Lösungen migrieren, die besser mit agilen und skalierbaren Technologiestacks übereinstimmen, die von kürzeren Markteinführungszeiten und geringeren Betriebskosten profitieren. Die von Unternehmen angenommenen Entwicklungstools für den Aufbau robuster KI-Anwendungen tendieren zu Open-Source- und anpassbaren Stacks, einem Bereich, in dem OpenAIs Sora mit seinen proprietären Komplexitäten Schwierigkeiten hat, zu konkurrieren.

AI Tool Spotlight: Revolutionäre Enabler im Mac-Ökosystem

Während Macs im Bereich der KI-Entwicklung an Bedeutung gewinnen, sind mehrere Tools aufgetaucht, die für den Fortschritt dieses Ökosystems unerlässlich sind. Erstens ist CreateML, Apples maßgeschneidertes Machine Learning-Modellierungstool, das speziell für macOS entwickelt wurde. CreateML erleichtert schnelles Prototyping ohne umfangreiche Programmierkenntnisse, aber seine wahre Stärke liegt in der Integration mit Swift und anderen Entwicklungsumgebungen von Apple. Dies ermöglicht es Entwicklern, Modelle schnell zu iterieren und direkt in iOS- und macOS-Apps zu implementieren, was den Integrationsaufwand erheblich reduziert.

Ein weiteres entscheidendes Tool ist Apples Core ML, ein Machine Learning-Framework, das es Entwicklern ermöglicht, trainierte Modelle nahtlos in Anwendungen zu integrieren. Ein herausragendes Merkmal ist sein Modell-Konvertierungsaspekt, der es ermöglicht, in anderen Umgebungen erstellte Modelle für iOS und macOS zu optimieren. Die Fähigkeit von Core ML, eine Vielzahl von Eingaben zu verarbeiten und die Verarbeitung auf dem Gerät durchzuführen, bedeutet, dass die Datensicherheit gewahrt bleibt, ein wachsendes Anliegen in der heutigen datengesteuerten Wirtschaft. Beispielsweise nutzt SwiftHealth Core ML, um KI-gestützte Gesundheitsüberwachungsfunktionen zu integrieren, die den HIPAA-Standards entsprechen und den Benutzern datenschutzsensible Gesundheitsdatenanalysen ohne Cloud-Verarbeitung bieten.

Die Xcode-IDE spielt ebenfalls eine entscheidende Rolle und dient sowohl als Entwicklungsumgebung für den Code als auch als Werkzeug zur Leistungsoptimierung von Machine-Learning-Modellen. Neben der Beschleunigung des gesamten Entwicklungsworkflows bietet Xcode umfassenden Debugging- und Leistungsmetriken, die es Entwicklern ermöglichen, ihre Implementierungen auf granularer Ebene fein abzustimmen. Diese integrierte Umgebung ist ein erheblicher Anreiz für Entwickler, die ein kohärentes Entwicklungserlebnis mit der Leistungsstärke von Apples Hardware-Innovationen suchen.

Investieren in die KI-Renaissance: Die neue Mac-Wirtschaft

Nachdem sich der Staub der ersten Welle der KI-Störungen gelegt hat, richtet sich die Aufmerksamkeit auf die strategischen Investitionen, die in Mac-orientierte KI-Vorhaben fließen. Die Notwendigkeit, sich an einen wettbewerbsfähigen Markt anzupassen, in dem Geschwindigkeit, Innovation und Effizienz den Erfolg bestimmen, hat die Investoren dazu angeregt, ihre Portfolios zu überdenken. Mit einem prognostizierten jährlichen Wachstum des KI-Marktes von 42 %, laut aktuellen Schätzungen von Statista, ist die Arena bereit für diejenigen, die strategische Allianzen mit erfolgreichen Betriebssystemen wie Apple schaffen, wobei integrierte Überleistungstechnologie auf Zuverlässigkeit trifft.

Patron VC, der den Paradigmenwechsel erkannt hat, hat den “Future of AI Fund” initiiert, der sich ausschließlich auf KI-Startups konzentriert, die auf Apples Architektur setzen. Ihre Mission ist klar: Innovatoren zu unterstützen, die die Verarbeitungseffizienz, Sicherheitsfunktionen und Integrationspotenziale nutzen, die Macs bieten. Dies markiert eine bewusste Abkehr von früheren Fokussierungen auf Cloud-agnostische Infrastrukturen und unterstreicht einen Trend, bei dem vertikal integrierte Systeme als langfristig rentablere Investitionen angesehen werden.

Zudem sind nicht nur VCs die einzigen Entitäten, die sich an diese neue Realität anpassen. Etablierte Technologieriesen schließen Kooperationen mit Apple, um diese Fortschritte zu nutzen. Microsoft, einst ein Konkurrent, nutzt jetzt Macs in optimierten KI-Lösungen für Unternehmensangebote durch die Synergie zwischen seiner Office-Suite und den in macOS entwickelten maschinellen Lernfähigkeiten. Dieser Wandel zeigt eine Zukunft, in der strategische Partnerschaften und Technologieintegration den Wettbewerbsvorteil definieren, das Potenzial der KI-Innovation erweitern und vorantreiben.

| Aspekt | Der alte Weg (manuell) | Der neue Weg (KI/Technik) |

|---|---|---|

| Prozesskomplexität | Hohe Komplexität mit manueller Intervention | Verschlankt durch KI-Integration |

| Zeitersparnis | 0% – Keine Zeitersparnis, arbeitsintensiv | Bis zu 70% – Reduzierte Verarbeitungs- und Entscheidungszeit |

| Genauigkeit | Anfällig für menschliche Fehler | Höhere Genauigkeit durch Maschinenpräzision |

| Kostenkennzahlen | Höhere Betriebskosten durch Arbeit und Fehler | Niedrigere Betriebskosten durch Effizienz und weniger Fehler |

| Skalierbarkeit | Begrenzte Skalierbarkeit, erfordert mehr Ressourcen | Hohe Skalierbarkeit, schnelle Anpassung an größere Maßstäbe |

| Implementierungszeit | Lange Einrichtungs- und Implementierungszeiten | Kürzere Einrichtungszeit mit schneller Einsatzfähigkeit |

| Ressourcenzuweisung | Hoher Bedarf an menschlichen Ressourcen | Optimierte Zuweisung mit Fokus auf strategische Aufgaben |