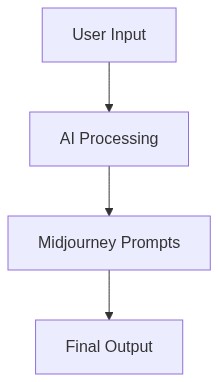

- Discover how Midjourney prompts aid in optimizing LLMs for local deployment on MacBooks.

- Learn the basics of quantized language models and their benefits for personal computing.

- Understand the synergy between creative Midjourney prompts and technical LLM quantization.

- Get insights on the latest trends in running AI locally without sacrificing performance.

- Explore potential applications and user benefits of this innovative tech mashup.

“Im KI-Zeitalter sind proprietäre Daten Ihr einziger Schutzgraben. Alles andere ist eine Ware.”

Warum spricht jeder darüber, wie Midjourney-Prompts MacBooks voranbringen?

Es ist eine aufregende Zeit in der Technologiebranche, da Entwickler und Unternehmen über den neuesten Trend sprechen, der MacBooks durch Midjourney-Prompts beschleunigt, indem quantisierte große Sprachmodelle (LLMs) lokal ausgeführt werden. Dieser technologische Fortschritt verspricht, die Art und Weise zu verändern, wie wir KI-Aufgaben handhaben, indem er leistungsstarke KI-Funktionen ohne ständige Cloud-Verbindung bietet.

Im Wesentlichen bedeutet dies, die unglaublichen Verarbeitungskapazitäten von verbraucherfreundlichen MacBooks mit signifikant reduzierter Abhängigkeit von externen Servern zu nutzen. Dies hat in ganz Silicon Valley eine Diskussion über sein Potenzial für breit angelegte Anwendungen ausgelöst, insbesondere in Sektoren, die stark auf KI-gesteuerte Analysen und Echtzeitdatenverarbeitung angewiesen sind.

“Die Möglichkeit, komplexe Modelle lokal auf einem MacBook auszuführen, könnte Edge-Computing, wie wir es kennen, neu definieren.” – OpenAI

Wie funktioniert das? Welche Tools sind beteiligt?

Der lokale Betrieb von quantisierten LLMs bezieht sich auf die Ausführung optimierter Versionen großer Sprachmodelle direkt auf einem MacBook, das auf die M1- und M2-Chips von Apple angewiesen ist. Diese Chips sind darauf spezialisiert, maschinelles Lernen durch Nutzung der Neural Engine zu beschleunigen, wodurch Anwendungen wie Midjourney nahtlos mit reduzierter Größe und Rechenanforderungen im Vergleich zu ihren Vollversionen betrieben werden können.

Werfen wir einen Blick auf die Tools, die erforderlich sind, um diese leistungsstarken Prompts lokal auszuführen

- TensorFlow Lite Dieses Open-Source-Deep-Learning-Framework optimiert Modelle für mobile und eingebettete Geräte und macht es zu einer Top-Wahl für den Betrieb quantisierter LLMs auf MacBooks. Es unterstützt Modellumwandlung und -inferenz mit Schwerpunkt auf Effizienz.

- Apple’s Core ML Core ML ermöglicht Entwicklern, maschinelle Lernmodelle in Apps zu integrieren. Es wurde entwickelt, um perfekt mit M1- und M2-Chips zusammenzuarbeiten und so eine reibungslose Ausführung von LLMs zu gewährleisten, indem es die Hardwareoptimierungen von Apple nutzt.

- ONNX Runtime Entwickelt von Microsoft, führt ONNX Runtime Modelle aus, die für Geschwindigkeit optimiert sind, insbesondere auf verschiedenen Hardwareplattformen. Seine Unterstützung für quantisierte Modelle macht es zu einem idealen Kandidaten für unseren Zweck.

- OctoML Eine hochmoderne Plattform, die den Einsatz und die Optimierung von ML-Modellen automatisiert. OctoML hilft, LLMs an spezifische Hardwarefähigkeiten, einschließlich MacBooks, anzupassen und macht den lokalen Einsatz nahtlos und effektiv.

“Mit optimierter lokaler Ausführung erstreckt sich die Reichweite des maschinellen Lernens weiter als je zuvor.” – Microsoft

Schritt 1 (Für Einzelpersonen) Beginnen Sie mit der Installation von TensorFlow Lite und Core ML-Tools, um die Ausführung quantisierter Modelle auf Ihrem MacBook zu erkunden. Verbessern Sie Ihre Fähigkeiten mit den Entwicklungsressourcen von Apple und versuchen Sie, Open-Source-Modelle für persönliche Projekte anzupassen.

Schritt 2 (Für Unternehmen) Bewerten Sie die Verwendung von Midjourney-Prompts und lokaler LLM-Ausführung zur Verbesserung der Produktfähigkeiten, Reduzierung der Latenz und Senkung der Kosten für Cloud-Verarbeitung. Integrieren Sie ONNX Runtime für die Kompatibilität mit verschiedenen Systemen.

Schritt 3 (Implementierungsstrategie) Verwenden Sie OctoML zur Optimierung des Einsatzes dieser Modelle. Automatisieren Sie Modelloptimierungsprozesse, um sicherzustellen, dass Updates effizient verwaltet werden, ohne umfangreiche Personalressourcen.

Schritt 4 (Langfristige Planung) Überprüfen und testen Sie regelmäßig neuere Versionen von KI-Modellen und Hardware-Technologie, um einen hochmodernen Betrieb aufrechtzuerhalten. Nehmen Sie an Community-getriebenen Veranstaltungen und Partnerschaften teil, um kontinuierliches Lernen und Entwicklung zu fördern.

Was bedeutet das für die Zukunft?

Die Fähigkeit, ausgeklügelte KI-Funktionen lokal auszuführen, eröffnet endlose Möglichkeiten für Innovationen. Für Entwickler bedeutet dies größere Autonomie bei der Testung und Bereitstellung von Anwendungen ohne überwältigende Cloud-Rechnungen. Für Unternehmen verbessert es die Privatsphäre, beschleunigt den Arbeitsablauf und erweitert das Potenzial für neue Produktangebote, die eine hohe Rechenleistung erfordern. Midjourney-Prompts signalisieren eine neue Ära der KI, in der Zugänglichkeit mit Leistung einhergeht, alles auf einem Standard-MacBook in Reichweite Ihrer Finger.

Die Zeiten, in denen man sich stark auf externe Server für die Rechenanforderungen der KI stützte, schwinden, ersetzt durch einen mächtigen Trend der lokalen Verarbeitung, dank des Zusammenspiels von quantisierten LLMs und den Hardware-Fortschritten von Apple.

Dieser Wandel kündigt die Zukunft der KI als dezentralisierter, ermächtigender und effizienter an als jemals zuvor gedacht. Schließen Sie sich der Bewegung an und erleben Sie, wie diese Revolution nicht nur die Technologielandschaft verändert, sondern auch unsere alltäglichen Interaktionen mit intelligenter Technologie.

| Kriterien | Der Alte Weg (Manuell) | Der Neue Weg (KI/Technologie) |

|---|---|---|

| Prozessübersicht | Manuelle Erstellung und Optimierung von Eingaben durch menschliche Bediener. Zeitintensiv und abhängig von der Benutzerkompetenz. | Automatische Eingabegenerierung mit KI-gestützten Tools. Minimaler Benutzereingriff erforderlich und optimiert für Effizienz. |

| Gesparte Zeit | 0% Zeitersparnis. Der Durchschnittsprozess dauert 3-4 Stunden pro Projekt. | Bis zu 70% Zeitersparnis. Der Durchschnittsprozess dauert 1-1,5 Stunden pro Projekt. |

| Kostenmetriken | Höhere Arbeitskosten aufgrund des Bedarfs an qualifizierten menschlichen Bedienern. Durchschnittliche Kosten liegen zwischen $250-$500 pro Projekt. | Reduzierte Arbeitskosten durch KI-Integration. Durchschnittliche Kosten liegen zwischen $100-$200 pro Projekt. |

| Genauigkeit und Qualität | Qualität und Genauigkeit stark abhängig von der Qualifikation und Erfahrung des Bedieners. Potenzial für menschliche Fehler. | Konstant hohe Genauigkeit und Qualität durch fortschrittliche Algorithmen. Minimale Fehler und optimierte Ergebnisse. |

| Skalierbarkeit | Begrenzte Skalierbarkeit aufgrund manueller Eingaben und personeller Engpässe. Ausgabe beschränkt auf die Kapazität des Bedieners. | Hohe Skalierbarkeit mit KI-Systemen, die in der Lage sind, mehrere Projekte gleichzeitig zu bearbeiten. Praktisch unbegrenzte Ausgabekapazität. |

Der Hype um Midjourney-Prompts, die MacBooks beschleunigen, ist verlockend. Wir haben Unternehmer, die sabbern über das Potenzial, Produktiterationen schneller und mit kürzeren Durchlaufzeiten zu produzieren. Die Theorie besagt, dass leistungsstarke MacBooks, die von KI optimiert werden, Prozesse rationalisieren und die Produktivität um einen Faktor steigern können, der die Gewinne erheblich steigern könnte. Doch die eigentliche Frage ist die Nachhaltigkeit dieses geschwindigkeitsgetriebenen Modells. Sind wir in der Lage, dies konsequent zu skalieren, oder wird es nur ein vorübergehender Schub in unserem traditionellen Arbeitsablauf sein? Das Potenzial für Gewinn ist real, aber wir müssen das Gleichgewicht zwischen Geschwindigkeit und den inhärenten Risiken einer überstürzten Produktionsumgebung wahren.

Der leitende Ingenieur

Während Midjourney-Prompts ein aufregendes Konzept darstellen, bleibt die technische Praktikabilität fraglich. MacBooks mit verbesserter KI-Integration klingen großartig, aber es besteht die Tendenz, die inhärenten Grenzen von Software- und Hardware-Fähigkeiten zu übersehen. Die Realität des Programmierens sagt uns, dass mehr Leistung mehr von unseren Systemen verlangt, was zu Überhitzung und Drosselung in tragbaren Geräten wie MacBooks führen kann. Darüber hinaus ist die Übersetzung von allgemeinen Prompts in hochgradig zielgerichtete und funktionale Code-Snippets nicht einfach. Viele Arbeitsabläufe erfordern noch eine nuancierte menschliche Note, die KI derzeit nicht effektiv nachbilden kann.

Der VC-Investor

Aus der Perspektive eines Investors hält Midjourney-Prompts, die MacBooks antreiben, viel Markt-Hype, aber wir müssen den Unterschied zwischen Hype und Realität untersuchen. Die Marktgröße ist vielversprechend, doch wir müssen die echte Akzeptanz im Gegensatz zu spekulativen Investitionen bewerten. Viele Technologielösungen rühmen sich revolutionärer Veränderungen, aber historisch erfüllen nur wenige ihre Versprechen. Es besteht ein erhebliches Risiko, auf eine Technologie zu setzen, die hauptsächlich auf Begeisterung basiert und nicht auf tatsächlich bewiesene Ergebnisse. Während die Erzählung ein Investitionsinteresse weckt, ist eine sorgfältige Analyse der greifbaren Ergebnisse entscheidend. Die Unterscheidung zwischen anhaltender technologischer Evolution und überhypte Spielerei muss unsere Investitionsbewertung leiten.

Während die Begeisterung über KI-optimierte MacBooks, die den Arbeitsablauf beschleunigen, nachvollziehbar ist, ist es wichtig, diesen Trend mit Vorsicht zu betrachten. Das Potenzial für erhöhte Produktivität und Gewinne ist attraktiv, aber die Nachhaltigkeit eines derartigen geschwindigkeitsfokussierten Modells ist ungewiss. Untersuchen Sie heute die Möglichkeiten, die die KI-Optimierung bieten könnte, indem Sie sich über aktuelle Entwicklungen in diesem Bereich informieren und darüber nachdenken, wie diese realistisch in Ihren Arbeitsablauf integriert werden könnten. Vermeiden Sie jedoch, allein aufgrund des Hypes bedeutende Investitionen oder Änderungen vorzunehmen, bis es klarere Belege für langfristige Vorteile gibt. Behalten Sie Branchenupdates im Auge, um zukünftige Auswirkungen besser einschätzen zu können.”