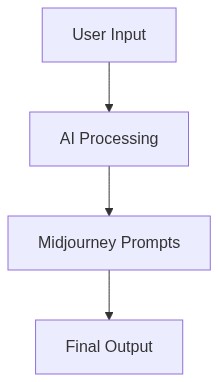

- Discover how Midjourney prompts aid in optimizing LLMs for local deployment on MacBooks.

- Learn the basics of quantized language models and their benefits for personal computing.

- Understand the synergy between creative Midjourney prompts and technical LLM quantization.

- Get insights on the latest trends in running AI locally without sacrificing performance.

- Explore potential applications and user benefits of this innovative tech mashup.

“En la era de la IA los datos propietarios son tu único foso. Todo lo demás es una mercancía.”

¿Por Qué Todo El Mundo Habla De Los Prompts De Midjourney Potenciando Los MacBooks?

Es un momento emocionante en el ámbito tecnológico con desarrolladores y empresas entusiasmo alrededor de la última tendencia que está turbocargando MacBooks utilizando prompts de Midjourney al ejecutar modelos de lenguaje de gran tamaño cuantizados (LLMs) localmente. Este avance tecnológico promete transformar cómo manejamos tareas de IA, ofreciendo potentes capacidades de IA sin necesidad de conectividad constante a la nube.

En esencia, esto significa aprovechar las increíbles capacidades de procesamiento de los MacBooks de consumo con una dependencia significativamente reducida en servidores externos. Esto ha desatado una discusión en todo Silicon Valley sobre su potencial para aplicaciones generalizadas, especialmente en sectores que dependen en gran medida del análisis impulsado por IA y el procesamiento de datos en tiempo real.

“La capacidad de ejecutar modelos complejos localmente en un MacBook podría redefinir la computación en el borde tal como la conocemos.” – OpenAI

¿Cómo Funciona Esto? ¿Qué Herramientas Están Involucradas?

Ejecutar LLMs cuantizados localmente se refiere a ejecutar versiones simplificadas de grandes modelos de lenguaje directamente en un MacBook, que se basa en los chips M1 y M2 de Apple. Estos chips se especializan en acelerar tareas de aprendizaje automático aprovechando el Neural Engine, lo que permite que aplicaciones como Midjourney operen sin problemas con requisitos de tamaño y computación reducidos en comparación con sus contrapartes a gran escala.

Desglosamos el conjunto de herramientas necesario para ejecutar estos potentes prompts localmente

- TensorFlow Lite Este marco de aprendizaje profundo de código abierto optimiza modelos para dispositivos móviles y embebidos, convirtiéndolo en una elección principal para ejecutar LLMs cuantizados en MacBooks. Soporta la conversión e inferencia de modelos con un enfoque en la eficiencia.

- Core ML de Apple Core ML permite a los desarrolladores integrar modelos de aprendizaje automático en aplicaciones. Está diseñado para trabajar a la perfección con los chips M1 y M2, asegurando una ejecución fluida de LLMs aprovechando las optimizaciones de hardware de Apple.

- ONNX Runtime Desarrollado por Microsoft, ONNX Runtime ejecuta modelos optimizados para la velocidad, particularmente en plataformas de hardware variadas. Su soporte para modelos cuantizados lo convierte en un candidato ideal para nuestro propósito.

- OctoML Una plataforma de vanguardia que automatiza el despliegue y la optimización de modelos de ML. OctoML ayuda a adaptar LLMs a capacidades específicas de hardware, incluidos los MacBooks, haciendo que el despliegue local sea fluido y efectivo.

“Con la ejecución local optimizada, el alcance del aprendizaje automático se extiende más que nunca.” – Microsoft

Paso 1 (Para Individuos) Comienza instalando TensorFlow Lite y herramientas de Core ML para explorar la ejecución de modelos cuantizados en tu MacBook. Afina tus habilidades con los recursos de desarrollo de Apple e intenta remodelar modelos de código abierto para proyectos personales.

Paso 2 (Para Empresas) Evalúa el uso de prompts de Midjourney y la ejecución local de LLM para mejorar las capacidades del producto, reducir la latencia y recortar costos asociados con el procesamiento en la nube. Incorpora ONNX Runtime para la compatibilidad a través de diversos sistemas.

Paso 3 (Estrategia de Implementación) Utiliza OctoML para agilizar el despliegue de estos modelos. Automatiza los procesos de optimización de modelos para asegurarte de que las actualizaciones se gestionen de manera eficiente sin necesidad de una gran cantidad de personal.

Paso 4 (Planificación a Largo Plazo) Revisa y prueba regularmente versiones más nuevas de modelos de IA y tecnología de hardware para mantener una operación a la vanguardia. Participa en eventos y asociaciones impulsados por la comunidad para un aprendizaje y desarrollo continuos.

¿Qué Significa Esto Para El Futuro?

La capacidad de ejecutar funciones sofisticadas de IA localmente abre infinitas posibilidades para la innovación. Para los desarrolladores, significa una mayor autonomía en la prueba y despliegue de aplicaciones sin abrumar las facturas de la nube. Para las empresas, mejora la privacidad, acelera el flujo de trabajo y amplía el potencial de nuevas ofertas de productos que requieren un gran poder de cómputo. Los prompts de Midjourney significan una nueva era en IA donde la accesibilidad se iguala al rendimiento, todo al alcance de tus manos en un MacBook estándar.

Los días de depender excesivamente de servidores remotos para las demandas computacionales de la IA están desapareciendo, reemplazados por una tendencia empoderadora de procesamiento local, gracias a la sinergia entre LLMs cuantizados y los avances de hardware de Apple.

Este cambio anuncia el futuro de la IA como más descentralizado, empoderador y eficiente de lo que se imaginaba anteriormente. Únete al movimiento y presencia cómo esta revolución cambia no solo el panorama tecnológico sino nuestras interacciones cotidianas con la tecnología inteligente.

| Criterio | La Forma Antigua (Manual) | La Nueva Forma (IA/Tecnología) |

|---|---|---|

| Descripción del Proceso | Generación y ajuste manual de instrucciones por operadores humanos. Requiere mucho tiempo y depende de la experiencia del usuario. | Generación automática de instrucciones utilizando herramientas impulsadas por IA. Requiere mínima intervención del usuario y está optimizado para la eficiencia. |

| Tiempo Ahorrado | 0% de ahorro de tiempo. El proceso promedio toma de 3 a 4 horas por proyecto. | Hasta un 70% de ahorro de tiempo. El proceso promedio toma de 1 a 1.5 horas por proyecto. |

| Métricas de Costo | Mayores costos laborales debido a la necesidad de operadores humanos cualificados. El costo promedio varía entre $250-$500 por proyecto. | Reducción de costos laborales con la integración de IA. El costo promedio varía entre $100-$200 por proyecto. |

| Precisión y Calidad | La calidad y precisión dependen en gran medida de la habilidad y experiencia del operador. Potencial de error humano. | Alta precisión y calidad consistente utilizando algoritmos avanzados. Mínimos errores y resultados óptimos. |

| Escalabilidad | Escalabilidad limitada debido a la entrada manual y las restricciones de recursos humanos. La producción está limitada a la capacidad del operador. | Alta escalabilidad con sistemas de IA capaces de gestionar múltiples proyectos simultáneamente. Capacidad de producción virtualmente ilimitada. |

Aunque el entusiasmo por los MacBooks optimizados por IA que aceleran el flujo de trabajo es comprensible es crucial abordar esta tendencia con precaución. El potencial para aumentar la productividad y los beneficios es atractivo pero la sostenibilidad de un modelo tan enfocado en la velocidad es incierta. Hoy explora las posibilidades que la optimización por IA podría ofrecer investigando los desarrollos actuales en esta área y considerando cómo podrían integrarse de manera realista en tu flujo de trabajo. Sin embargo evita realizar inversiones o cambios significativos basados únicamente en el bombo hasta que haya evidencia más clara de beneficios a largo plazo. Mantente al tanto de las actualizaciones de la industria para evaluar mejor los impactos futuros.”